通过文化和情感与自治机器的合作

可以代表我们的自治机器迅速成为我们社会的基础。机器人,无人机和自动驾驶车辆都成为一个现实,潜力塑造了我们的存在。这些机器可以深刻地改变我们如何相互互动,因此我们必须了解它们是否会影响人为决策的任何重大变化。

日本州陆军研究实验室的计算机科学家和Kazunori Terada副教授博士博士表明,岐阜大学副教授们表明,人们倾向于制造不太有利的决策,并与机器的合作较少与人类。结果表明,人们从事社会分类,以区分人们,或“我们”,从机器或“他们”。这导致了对“他们”的不利偏见,这意味着机器被视为外汇成员。

组合和out-group

人们倾向于在社交互动期间归类他人。他们倾向于将更多人与某些人联系在一起,与群体自我识别,而且与他人的少,over-group。这可能导致偏见与群体成员合作;因此,促进集团的富裕和增加个人的生存可能性和收到长期福利的可能性。这种对群体成员资格的看法通常用于鼓励在涉及社会困境的情况下的合作。已经证明,人们以类似的方式分类机器,符合性别和文化刻板印象,优先有利于具有与自己类似的竞争的虚拟面和声音的虚拟面部的计算机。这将暗示,除了人们将社会分类应用于机器,机器也可以是本集团的成员。

研究表明,当与机器接触时,人们制定不同的决策并显示出不同的大脑活动模式,而不是与人类接触时,即使他们认为机器是社交行为者。结果还表明,在与人类处理机器时,人们会越来越少的情感,而且机器往往被视为出于集团的成员。

人们倾向于做出不太有利的决定,与机器的合作不如与人的合作。

提高人机互动的假设

梅洛博士和泰达博士解释说,由于自治机器在社会中变得无处不在,我们必须找到促进他们与人类之间的合作的方法。此外,这些解决方案将不得不超越不利的偏见。他们以前的工作和其他研究审查,他们提出了两个假设:首先,“关联文化成员的积极线索可以减轻违约不利偏见人员对机器的偏见”。其次,“情感表达可以超越基于社会类别的合作的期望”。

囚犯的困境

研究人员共招募了945名参与者,其中468名来自美国,477名来自日本。在参与20轮囚徒困境之前,参与者与文化相同或不同的对手配对。

在困境中,两名球员同时做出缺陷或合作的决定。决策理论会提出叛逃是不管对应的决定如何的最佳反应:如果您认为您的同行将缺陷,那么您也应该缺陷;如果您认为您的同行将要合作,那么您仍然应该缺陷并最大限度地提高您的回报。然而,如果两个参与者都遵循这种推理,他们将最终比合作更糟糕。

人类VS自主机器对应物

实验完全是匿名的,因为参与者和实验者彼此匿名。参与者被告知他们将与另一个参与者或自主机器接触。但是,为了最大限度地提高实验控制,所有参与者实际与计算机脚本都与计算机脚本进行了。实验的重点是调查参与者是否与人类不同于机器,如果有任何差异可以用文化或面部表达的情感调节。

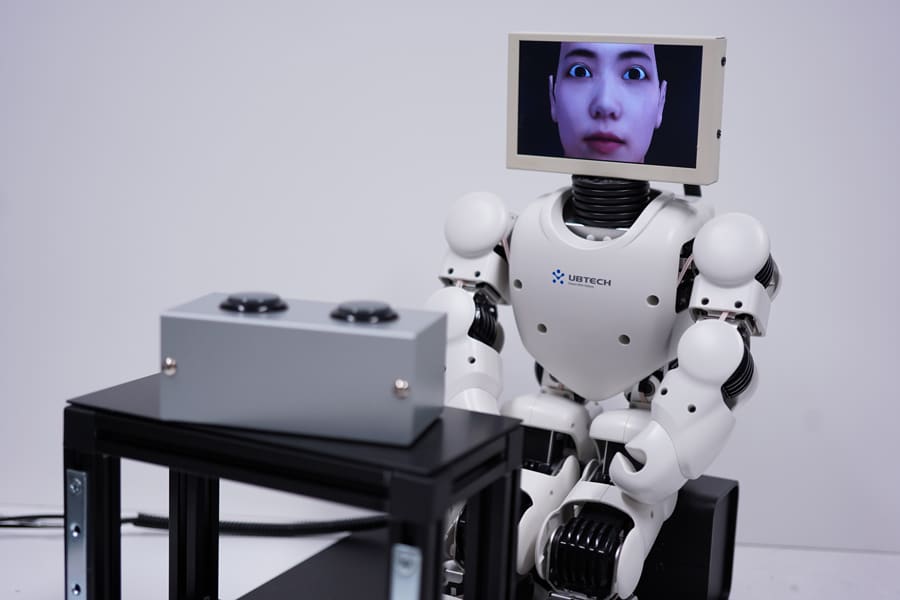

人类和机器对应物都能够使用来自美国或日本文化的虚拟面孔表达情感。他们呈现了竞争,中立或合作的性格。De Melo博士的早期研究揭示了情绪表达可以影响囚犯困境中的合作,因此研究人员选择了许多设置模式显示竞争,合作或中性情绪的序列。使用衡量标记囚犯困境的衡量标准,研究人员进行了统计分析,采用了参与者之间的2×2×3的统计分析。这使得对对手类型(人或机器),对应文化(美国或日本)和情感(竞争,中性或合作)同时进行的影响分析。

搭配不同的文化

当对不同的文化时,当他们认为他们有人类的同行而不是机器时,参与者更多地合作。当参与者与合作和中立伙伴配对而不是竞争性同行时,还有更多合作。此外,当对应于竞争性或中性情绪时,他们的对应物与人类相同比机器更多。然而,当对应物证明合作情绪时,没有显着差异。这些结果适用于日本和美国的参与者。

相同文化的配对

比较的是,当对相同的文化时,参与者与人类或计算机对应物的合作没有显着差异。尽管如此,与合作和中性同行的合作,而不是竞争力。再一次,日本和美国参与者的结果没有显着差异。

当同行表现出合作情绪时,与机器或人类合作没有显着差异。

解决偏见的解决方案

研究人员提供两种解决方案,以克服机器不利的偏见,提高人机合作。首先,实验表明,与参与者参与人类机器互动的文化,通过计算机虚拟脸的种族,一种简单的文化提示足以减轻偏差。其次,传达隶属于情绪的面部表情形式的机制,促进了人机合作,覆盖了来自社会类别的联盟联盟的默认期望。此外,当机器表现出积极的情绪时,如合作和遗憾后的喜悦,研究人员发现,人们与机器合作的人和人类同行一样多。

情绪影响决策

研究小组在实验中发现,情绪的影响最大。一台展示来自不同文化群体的虚拟面孔的机器,会通过敏锐的视觉情感表现,被视为群体内的一员,在这种情况下,合作后的喜悦,剥削后的后悔。这项研究强调了情绪对人类行为的强大影响,尤其是决策。此外,研究表明,社会类别的默认关联是可以被推翻的。这是令人鼓舞的,因为在机器中很难控制社会类别的感知。

这些结果可以帮助自主机器设计者克服对机器的不利偏见,并为提高人机交互中的合作水平提供解决方案。

研究人员反映出,鉴于社会的越来越多,发现被视为外人的自治机器并不令人惊讶,因此,不太可能获得对本集团成员所带来的福利。

这项研究表明,人类将依靠他们已建立的心理机制来确定与机器的联系和合作。令人欣慰的是,我们对机器的行为与我们对人类的行为有着相同的心理机制,并为减少对机器的负面偏见提供了机会。

研究人员得出结论,“由于自主机器可以旨在利用这些驾驶人类行为的这些心理机制,他们介绍了促进更合作社的独特机会”。

个人反应

引发了对人机合作的兴趣,以及如何看到这项研究进展?